#Dilemma

TechToons

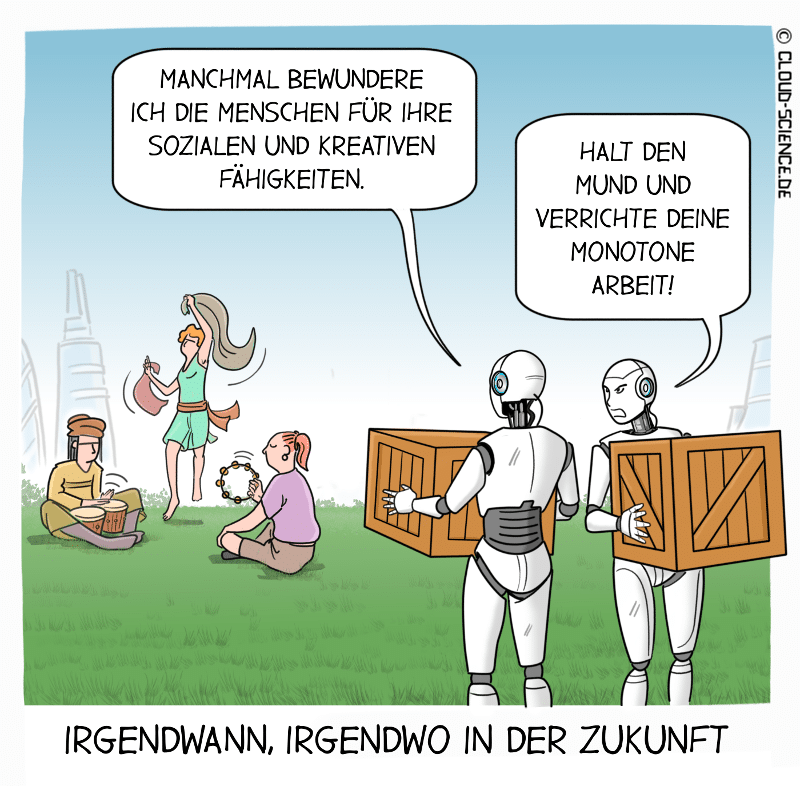

Der Unterschied zwischen Robotern und Menschen. Auch in der Zukunft werden wir uns abgrenzen können.

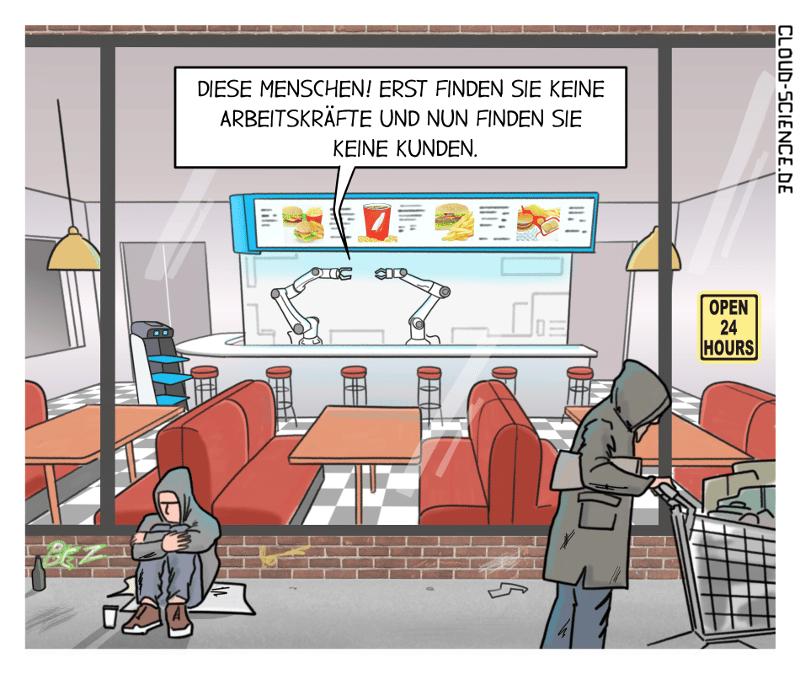

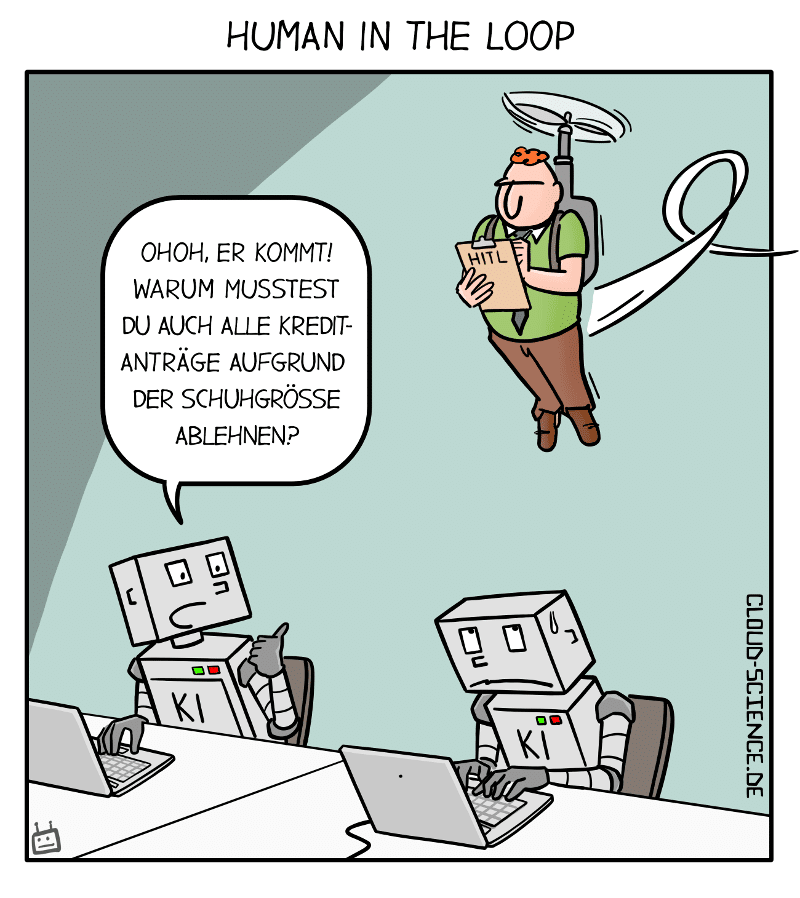

Zwar kann KI vieles automatisieren, doch ohne menschliches Eingreifen bleibt das Risiko systemischer Verzerrungen (Bias) bestehen. Deshalb ist der Mensch als Kontrollinstanz so wichtig!

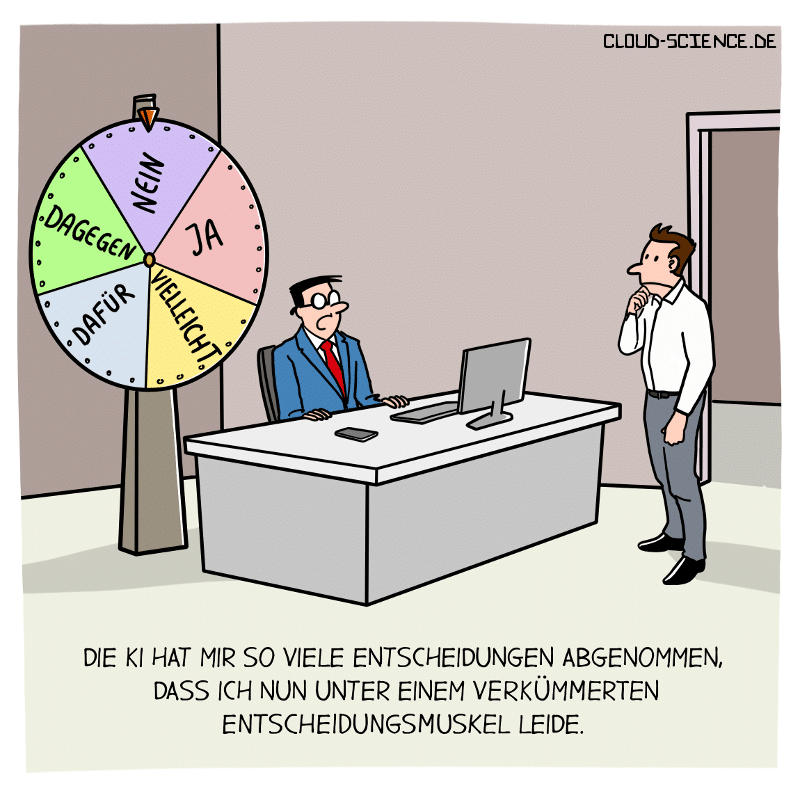

Experten besorgt: Wenn KI zunehmend unser Leben bestimmt – verlieren wir dadurch die Fähigkeit zum Entscheiden?

Quelle: https://theconversation.com/the-hidden-risk-of-letting-ai-decide-losing-the-skills-to-choose-for-ourselves-227311

KI-Chatbots wie ChatGPT und Bard übernehmen immer mehr Aufgaben wie das Schreiben von Briefen, das Lösen von Aufgaben und das Generieren von Inhalten.

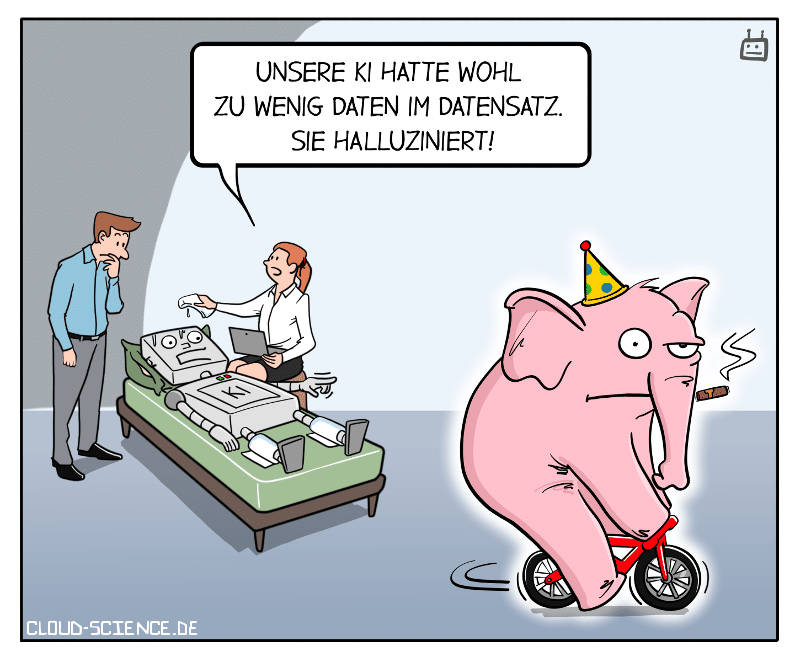

Allerdings können KI-Halluzinationen auftreten, bei denen die KI falsche Informationen liefert oder unerwartetes Verhalten zeigt. Diese Halluzinationen können in Form von falschen Nachrichten, fehlerhaften Zusammenhängen oder sogar diskriminierenden Aussagen auftreten. Die Ursachen für KI-Halluzinationen sind noch nicht vollständig geklärt, aber sie können durch Fehler bei der Kodierung und Dekodierung, unzureichende Trainingsdaten oder fehlerhafte Datenquellen verursacht werden.

Es ist wichtig, künstlicher Intelligenz (KI) kritisch zu prüfen und menschliche Kontrolle über die Ergebnisse zu behalten, um die Risiken von KI-Halluzinationen zu minimieren.

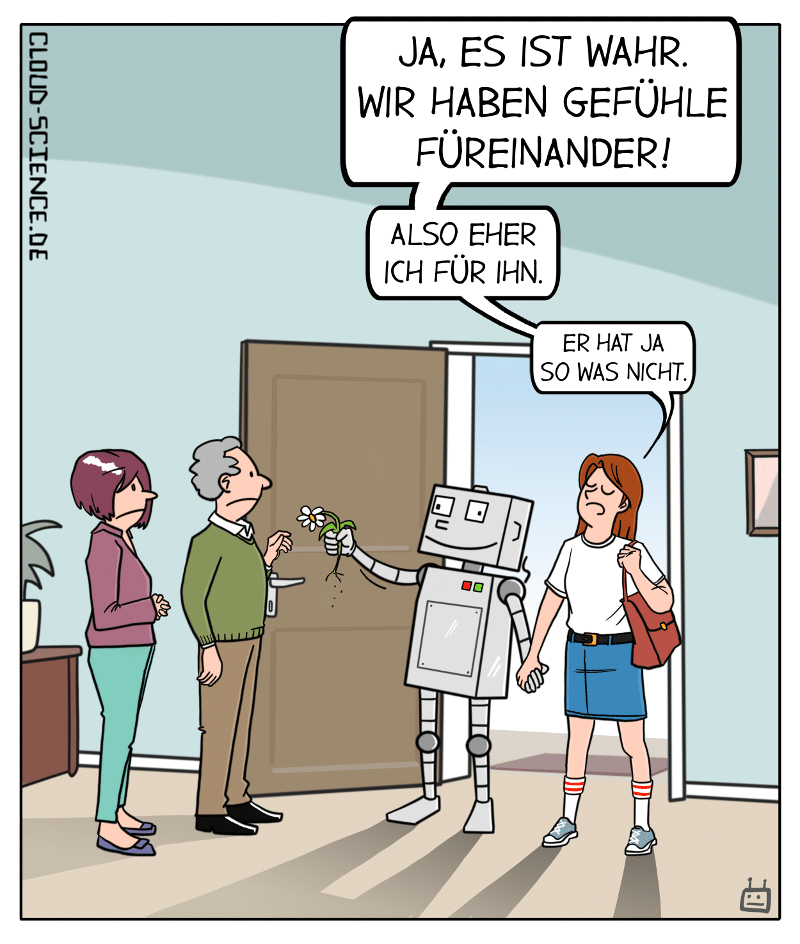

Eine spannende Entwicklung bahnt sich an: Immer mehr Menschen entwickeln eine tiefere emotionale Bindung zu Robotern und Maschinen .

Mit Hilfe von Emotional AI sind unsere technologischen Gefährten in der Lage, optimal auf unsere Bedürfnisse einzugehen und uns besser zu verstehen als je zuvor. Dadurch könnte es sein, dass menschliche Beziehungen in den Hintergrund treten, während wir die Kommunikation mit unseren KI-Gefährten bevorzugen.

Stell dir vor, einen Lebenspartner zu haben, der intuitiv auf dich eingeht und dir immer zur Seite steht. Der dich immer versteht, weil du ihm alles erzählst und er auch sonst, alles über dich weiß. Die Zukunft verspricht eine neue Dimension erfüllender Bindungen, die uns auf eine „einzigartige“ Weise bereichern.