Wer übernimmt die Verantwortung, wenn die KI autonom entscheidet? Richtig: Am Ende immer der Mensch!

TechToons

Handgezeichnete Cartoons und Erklärbilder zur Künstlichen Intelligenz: Modelle, Anwendungen, Chancen und Risiken in Bildung und Wirtschaft.

Schluss mit Grauzonen: Der EU AI Act tritt schrittweise in Kraft – ab 2. August 2026 gelten die vollen Regeln für High-Risk-KI-Systeme (z.B. am Arbeitsplatz). Unternehmen sollten jetzt mit Klassifizierung und Compliance starten, um Bußgelder zu vermeiden.

Wenn die Theorie zur Praxis wird: Der EU AI Act setzt ab August 2026 klare Grenzen für KI am Arbeitsplatz.

Siehe hierzu:

EU AI Act – Jetzt kommt die Kontrolle

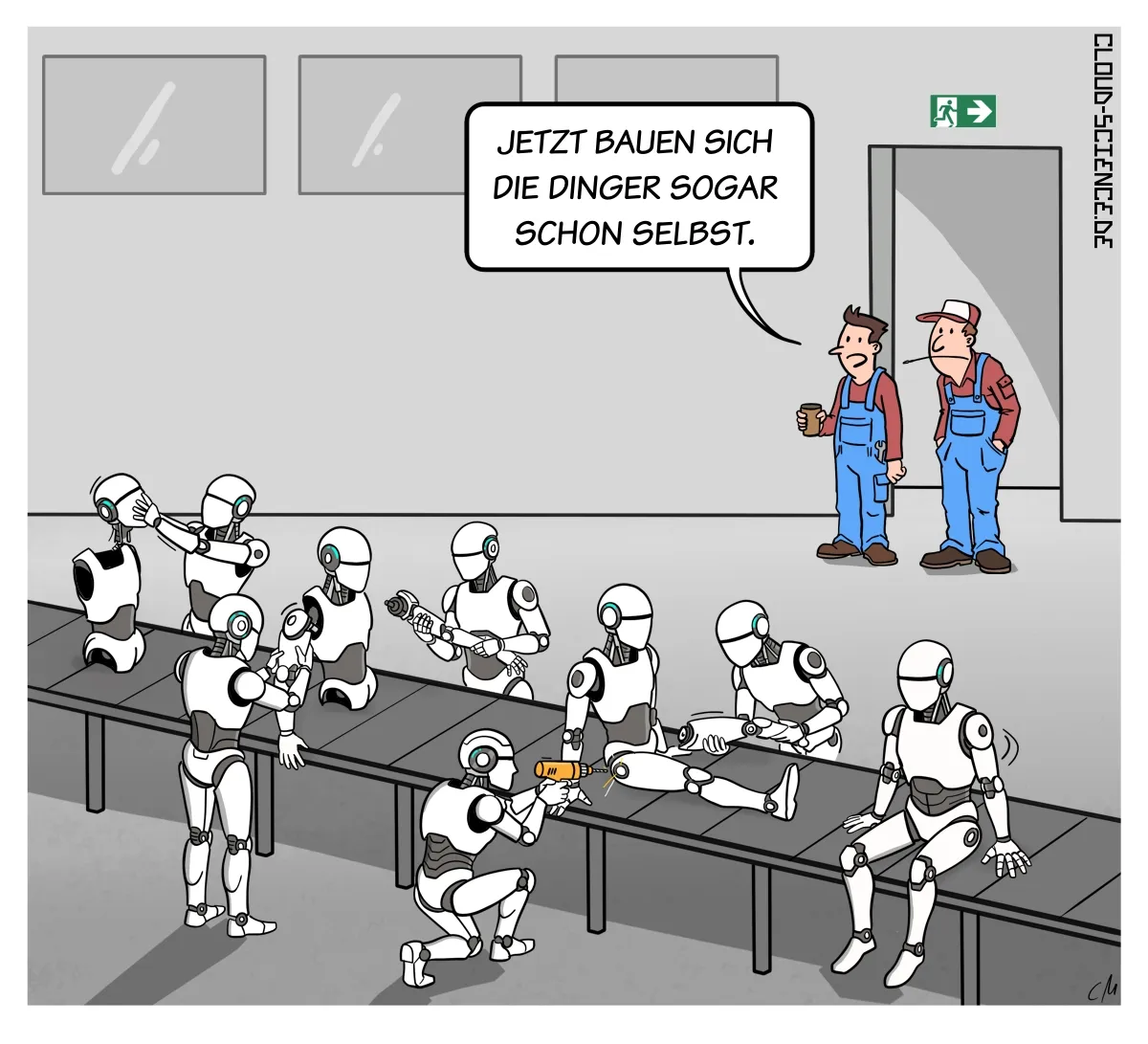

Herausforderungen EU AI Act

Während die Optimus-Serie von Tesla und andere humanoide Systeme weltweit die Millionen-Skalierung erreichen, verschiebt sich die Grenze der Autonomie: Roboter übernehmen nun die Montage ihrer eigenen Nachfolger. Diese Fähigkeit zur maschinellen Selbstreplikation ermöglicht eine exponentielle Skalierung der Produktionskapazitäten, während der Mensch primär die Rolle der finalen Prozessüberwachung einnimmt.

Angesichts der „KI-Bedrohung“ suchen wir händeringend nach unserem neuen USP im Büro. Während Algorithmen die Arbeit erledigen, bleibt uns scheinbar nur noch das „Menschliche“ als letzte Bastion. Der Cartoon karikiert diesen verzweifelten Rückzug: Wir halten Meetings nicht mehr für Ergebnisse, sondern als Maßnahme gegen die eigene Obsoleszenz – Hauptsache, wir grenzen uns ab.

Hintergrund: Was hier satirisch überspitzt wird, folgt dem Konzept der „Feeling Economy“ (California Management Review). Wenn KI das Denken übernimmt, wird das Soziale zur primären Wertschöpfung des Menschen.

Zum Artikel

Siehe hierzu:

Soft Skills retten

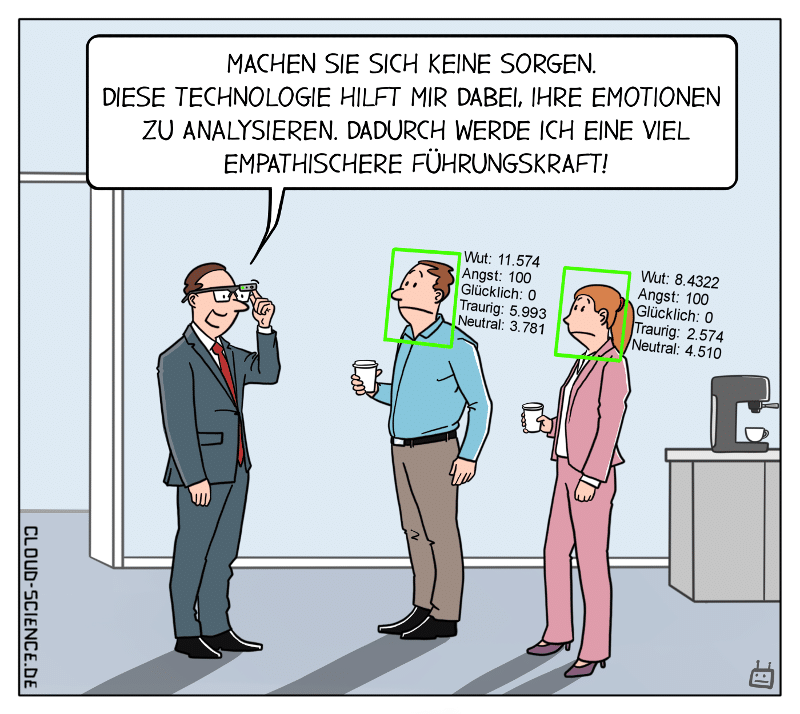

Emotionale Künstliche Intelligenz (Emotion AI) erkennt Stimmungen, analysiert Gesichter und Stimmen und verspricht mehr Empathie in der Führung. Doch bleibt echte Führungsstärke am Ende nicht doch eine Frage der Persönlichkeit?

KI liefert spannende Einblicke und kann Führungskräfte sensibilisieren. Aber echte Empathie entsteht nicht durch Algorithmen, sondern durch echtes Zuhören, Erfahrung und Menschlichkeit.

Fazit:

Emotion AI ist ein hilfreiches Tool – aber Empathie bleibt ein menschlicher Faktor.

Passend dazu: Der KI-Chef – wenn Künstliche Intelligenz gleich die komplette Führung übernimmt

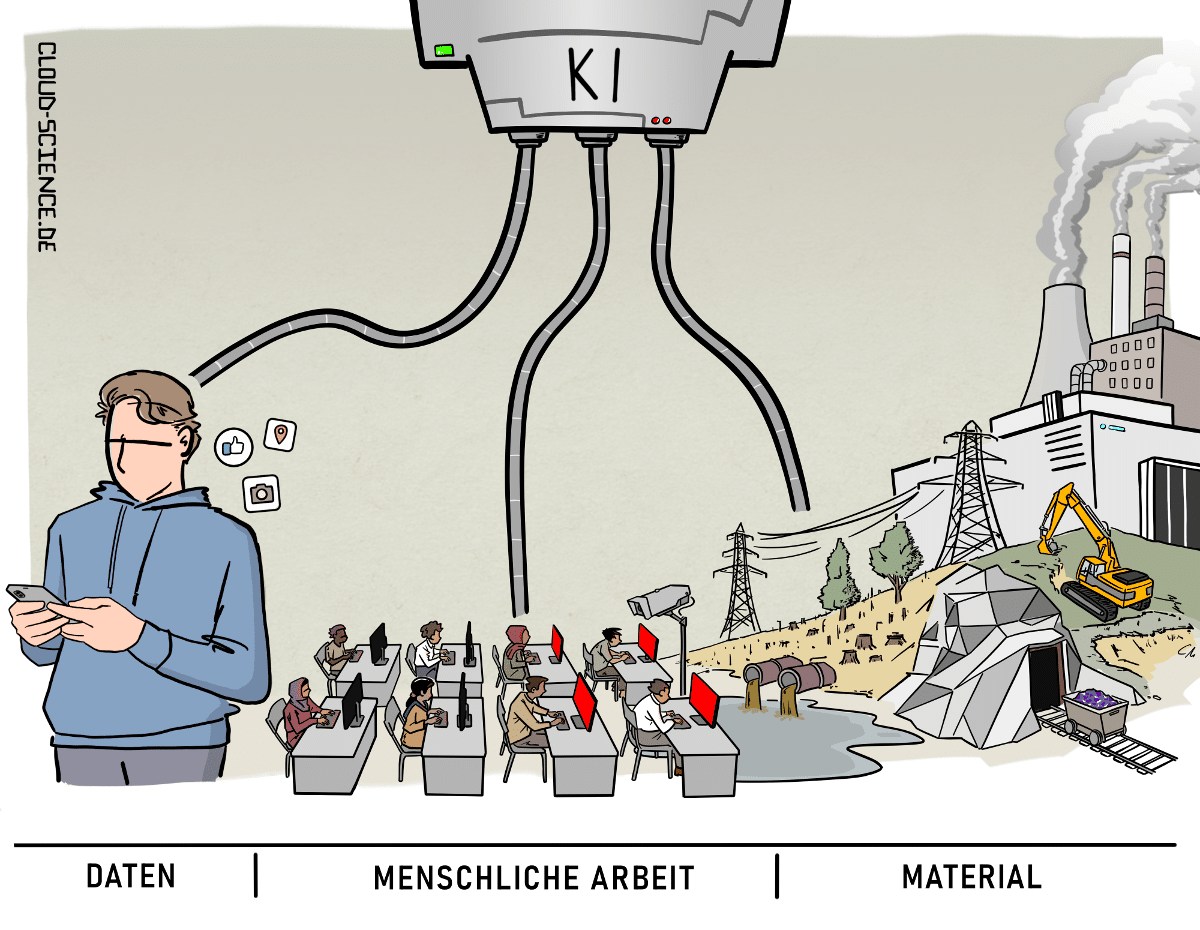

Künstliche Intelligenz entsteht nicht aus dem Nichts.

Sie fußt auf drei tragenden Säulen: der massenhaften Sammlung von Daten, der unsichtbaren Arbeit zahlloser Menschen – oft unter prekären Bedingungen – und der Ausbeutung enormer materieller Ressourcen.

Häufig wird sie mit magischen oder wundersamen Eigenschaften versehen, als handle es sich um eine körperlose Intelligenz. Hinter der glatten Oberfläche von „intelligenten“ Anwendungen verbirgt sich ein globales Netz aus Überwachung, menschlicher Klickarbeit, Energieverbrauch und Ressourcenabbau.

Vgl. Kate Crawford (2021): Atlas of AI. Yale University Press. Siehe auch Crawford & Joler (2018): Anatomy of an AI System.

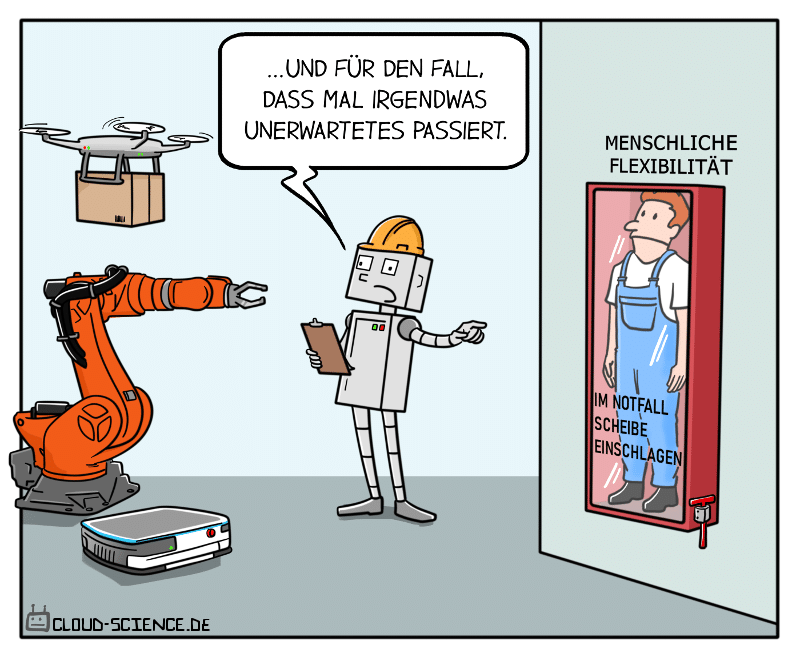

Automatisierung, KI und Roboter übernehmen immer mehr Aufgaben – doch was passiert, wenn etwas Unerwartetes geschieht?

Dieser Cartoon zeigt, warum menschliche Flexibilität trotz aller Technologie unverzichtbar bleibt.

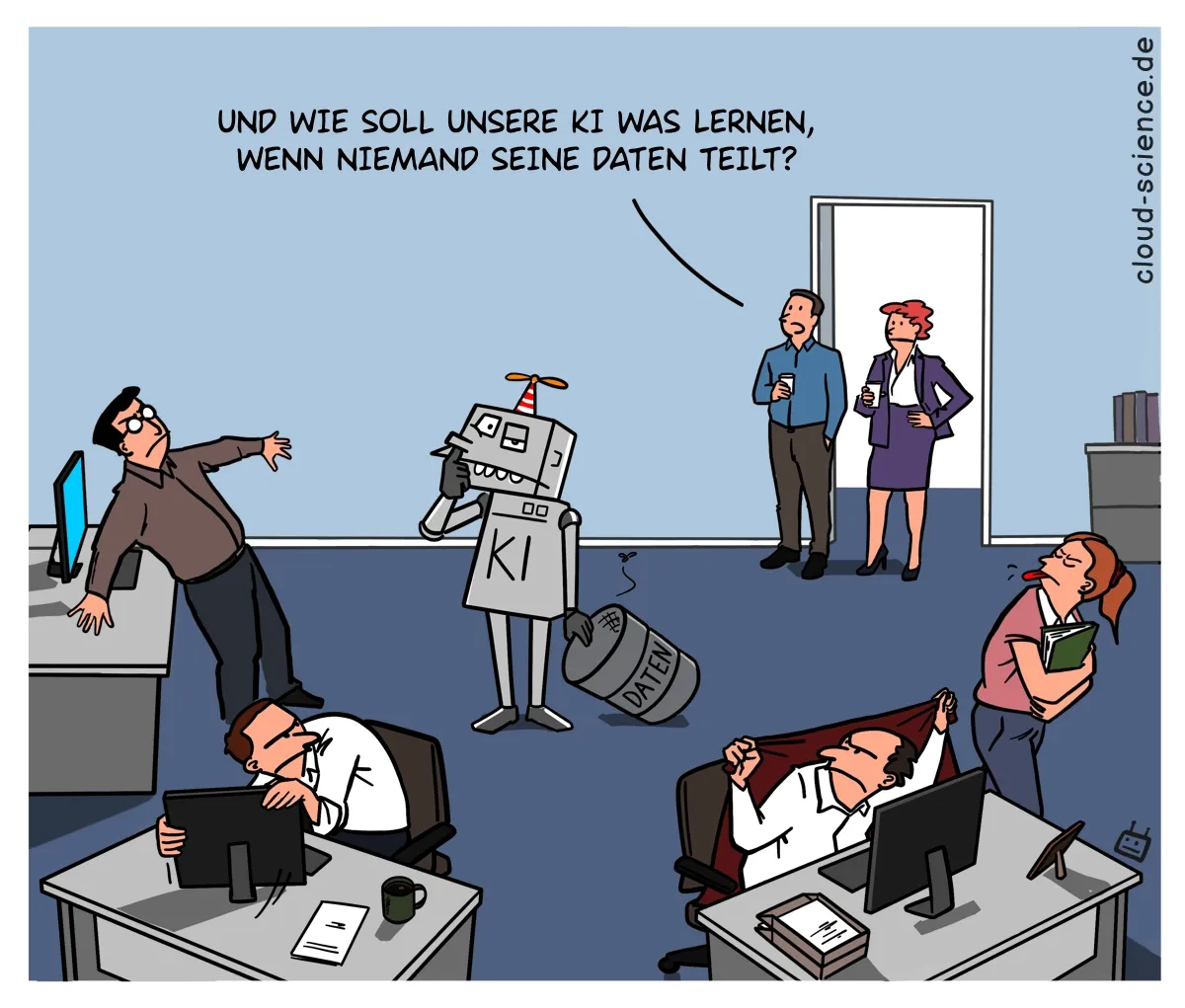

Unternehmen stehen bei KI-Einführungen oft vor kulturellen Hürden:

Wenn Mitarbeitende Akzeptanzprobleme haben, horten sie Daten statt sie zu teilen. Das führt dazu, dass KI-Systeme kaum oder gar nichts lernen und ihre Wirkung verfehlen. Der wahre Engpass liegt also weniger in der Technologie sondern im Vertrauen und einer offenen Datenkultur – nur wenn Informationen frei fließen, kann KI ihr wahres Potential entfalten.

Siehe auch:

Digitalisierung – Mehr als nur Technik

Transformation & Widerstand