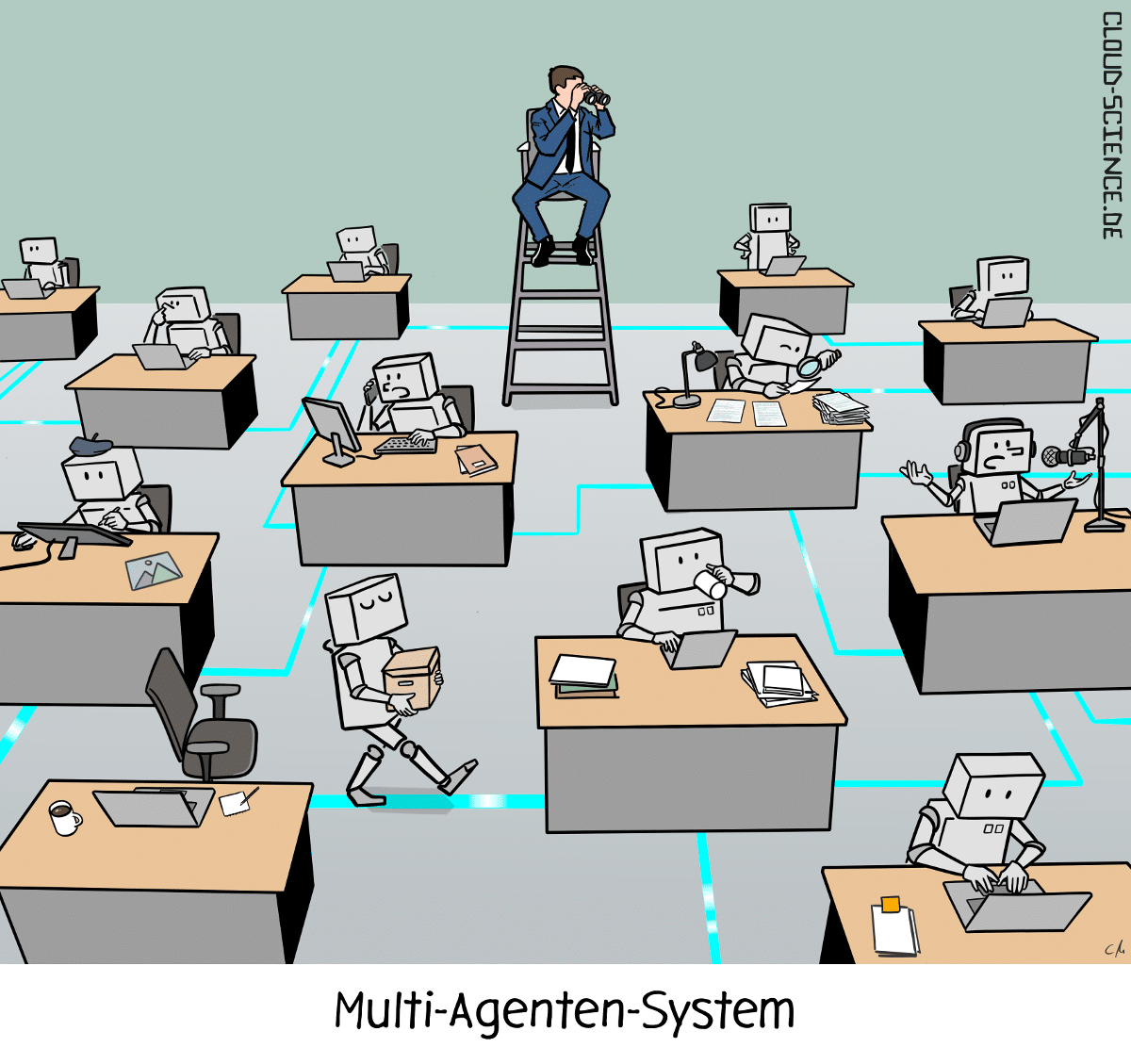

Illustration: Multi-Agenten-System

Ein Netzwerk vieler einzelner KI-Agenten, die gemeinsam komplexe Aufgaben lösen – aktuell meist noch unter der Beobachtung des Menschen.

Illustration MultiAgentenSystem Technologie

TechToons

Handgezeichnete Cartoons und Erklärbilder zur Künstlichen Intelligenz: Modelle, Anwendungen, Chancen und Risiken in Bildung und Wirtschaft.

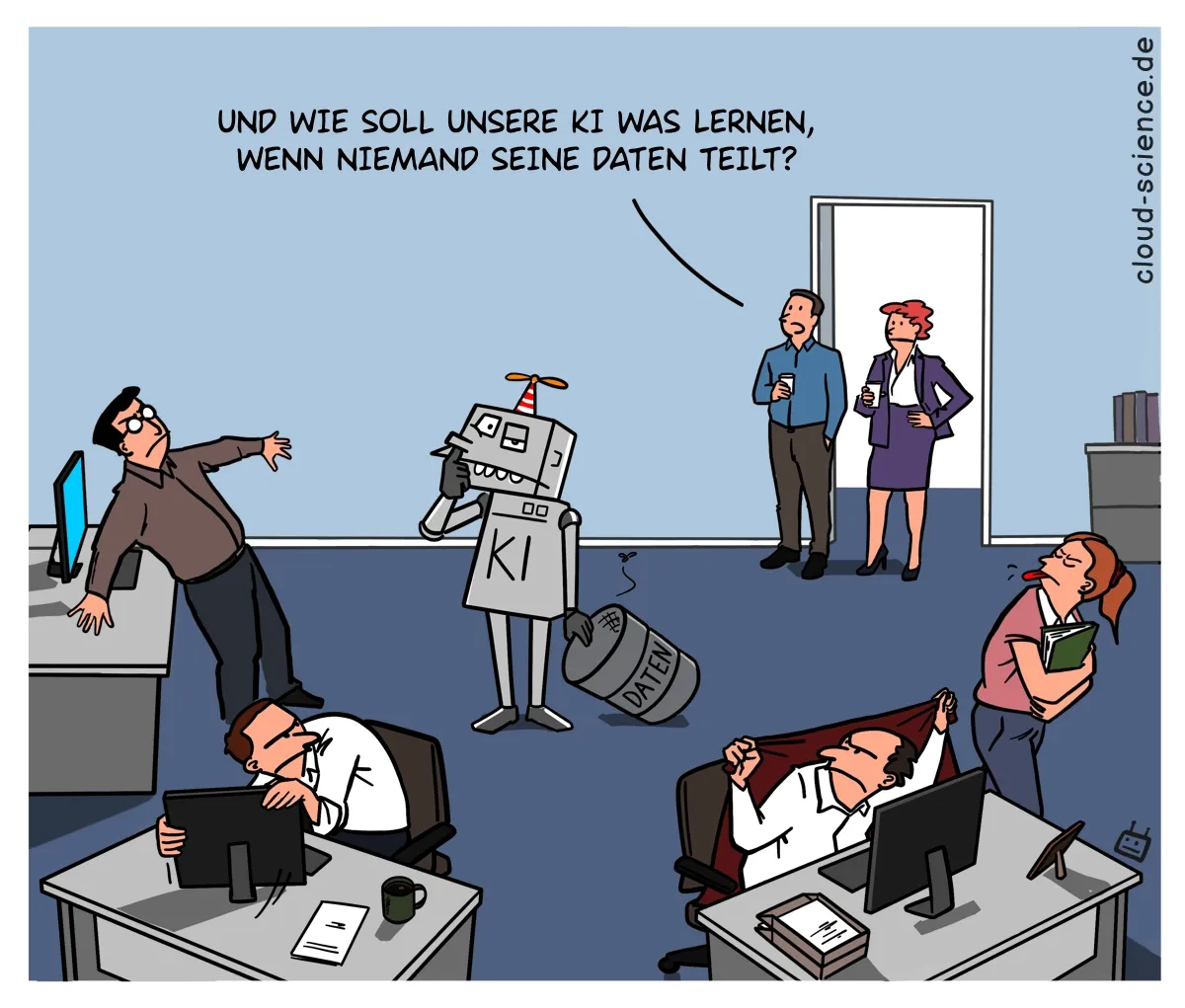

Unternehmen stehen bei KI-Einführungen oft vor kulturellen Hürden:

Wenn Mitarbeitende Akzeptanzprobleme haben, horten sie Daten statt sie zu teilen. Das führt dazu, dass KI-Systeme kaum oder gar nichts lernen und ihre Wirkung verfehlen. Der wahre Engpass liegt also weniger in der Technologie sondern im Vertrauen und einer offenen Datenkultur – nur wenn Informationen frei fließen, kann KI ihr wahres Potential entfalten.

Siehe auch:

Digitalisierung – Mehr als nur Technik

Transformation & Widerstand

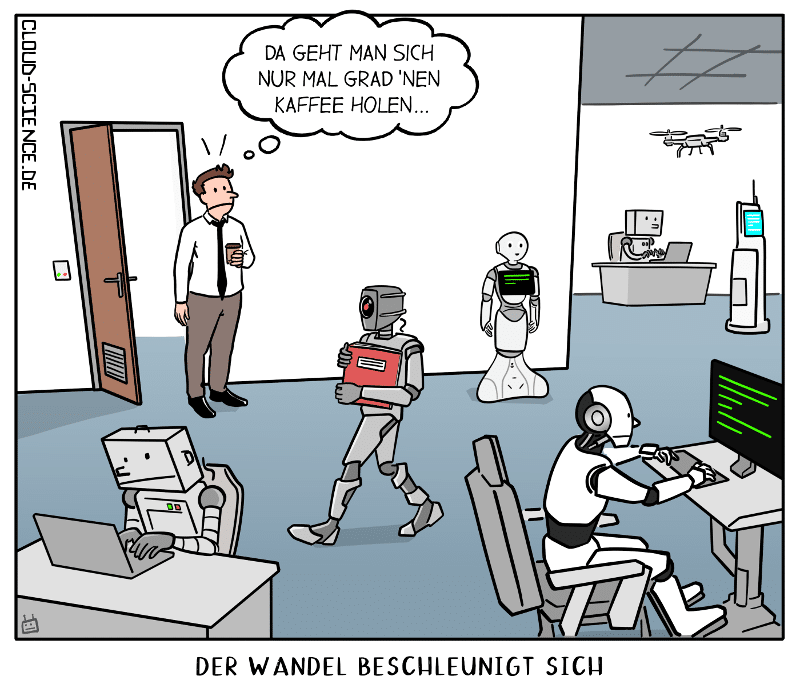

Der digitale Wandel legt einen Zahn zu: KI und Automatisierung krempeln die Arbeitswelt schneller um, als man gucken kann. Wer kurz nicht aufpasst, ist raus.

Siehe auch:

Kommunikation im Wandel

Die Wirtschaft im Wandel

Künstliche Intelligenz wirkt sauber, smart und autonom.

Doch hinter der glatten Oberfläche arbeiten Millionen Menschen im Verborgenen – als Datenannotator:innen.

Ausgelagert, schlecht bezahlt, psychisch belastet.

Sie klassifizieren Bilder, bewerten Texte, filtern Gewalt.

Ohne sie könnten Maschinen nichts erkennen, nichts verstehen, nichts leisten.

Siehe auch:

KI – Die Extraktionsmaschine

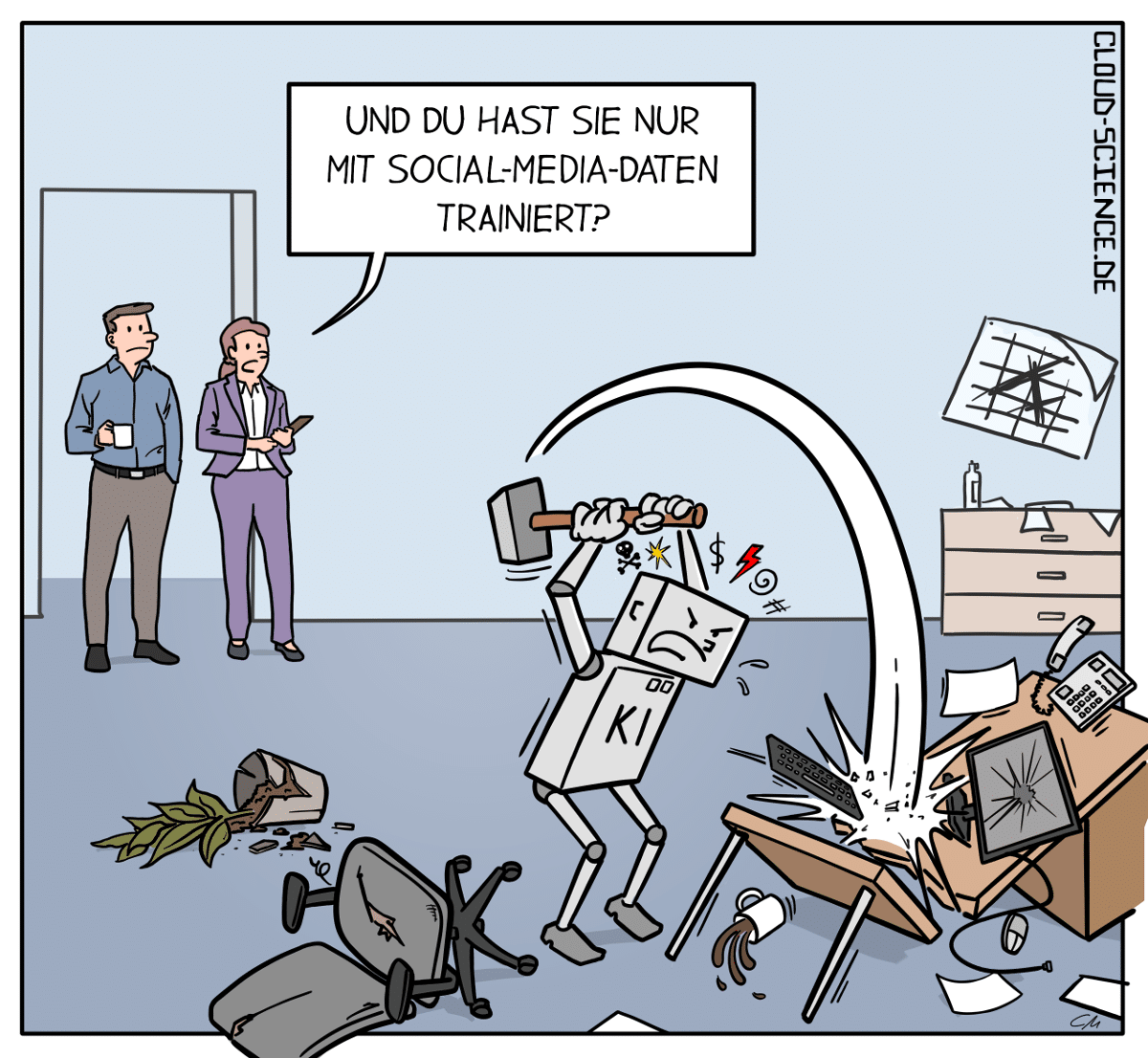

Ein Cartoon zeigt eine KI, die im Büro durchdreht – trainiert mit Social-Media-Daten, die alles andere als neutral oder objektiv sind.

Denn was in sozialen Netzwerken dominiert, ist oft emotional, populistisch, toxisch oder schlichtweg belanglos. Wenn eine KI daraus „lernt“, übernimmt sie die verzerrten Weltbilder – mit fatalen Folgen.

Das Motiv steht für ein reales Problem in der Entwicklung von KI-Systemen: Die Qualität und Herkunft der Datenbasis. Wenn diese verzerrt, lückenhaft oder oberflächlich ist, entstehen Risiken: algorithmische Fehlentscheidungen, Fehleinschätzungen und Kontrollverlust.

Ein zugespitztes Motiv für Präsentationen, Keynotes oder Fortbildungen zu den Themen AI Ethics, Datenqualität, Machine-Learning-Risiken oder Social Media als Datenquelle.

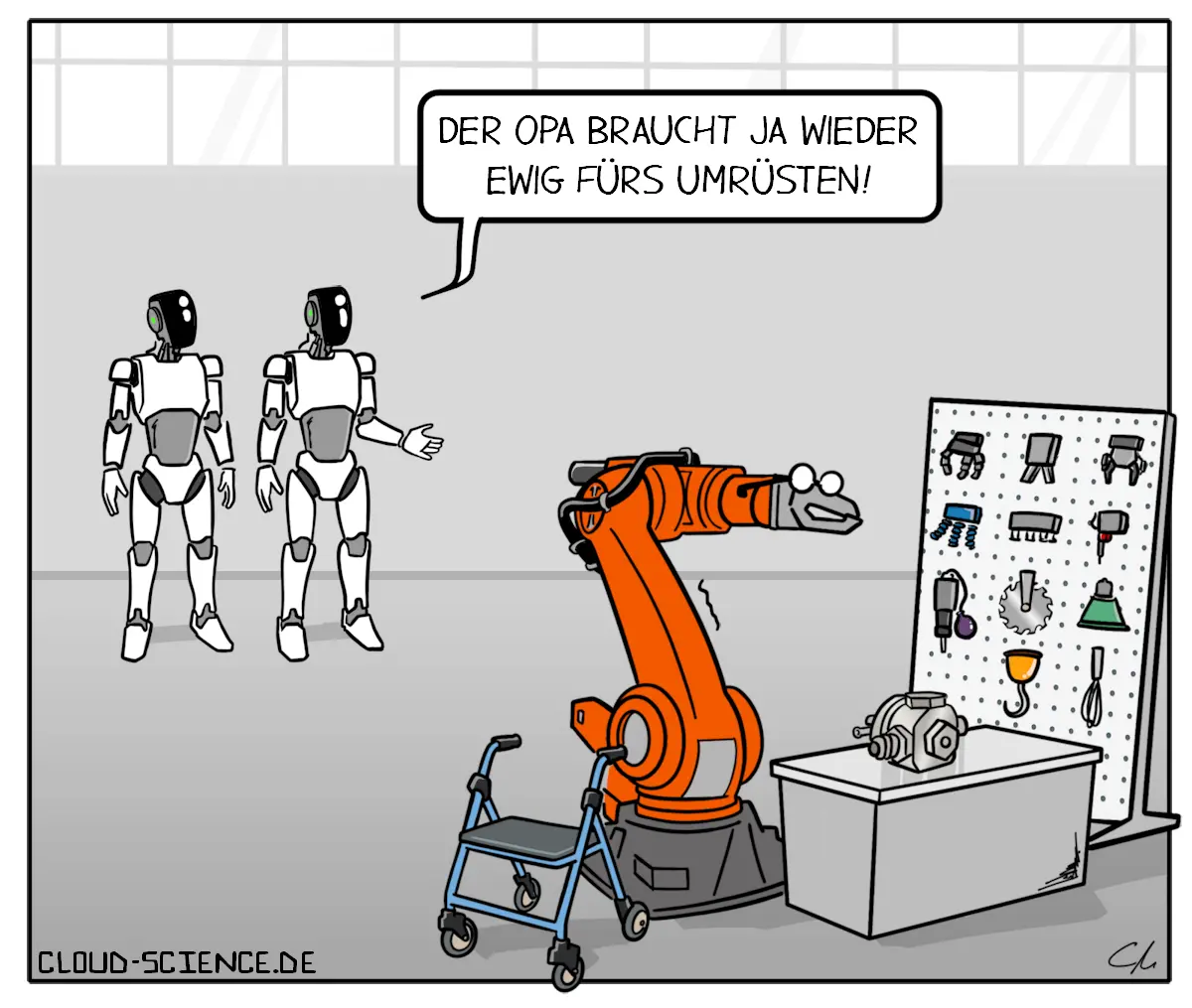

Humanoide Roboter verändern die Art und Weise, wie wir in der Fertigung arbeiten. Mit ihrer Flexibilität, Schnelligkeit und Kosteneffizienz durch weniger Stillstandzeiten setzen sie neue Maßstäbe für die Produktion von morgen.

Karikatur über den Sinn des Lernens in Zeitalter der Künstlichen Intelligenz

Siehe hierzu:

ChatGPT in der Bildung