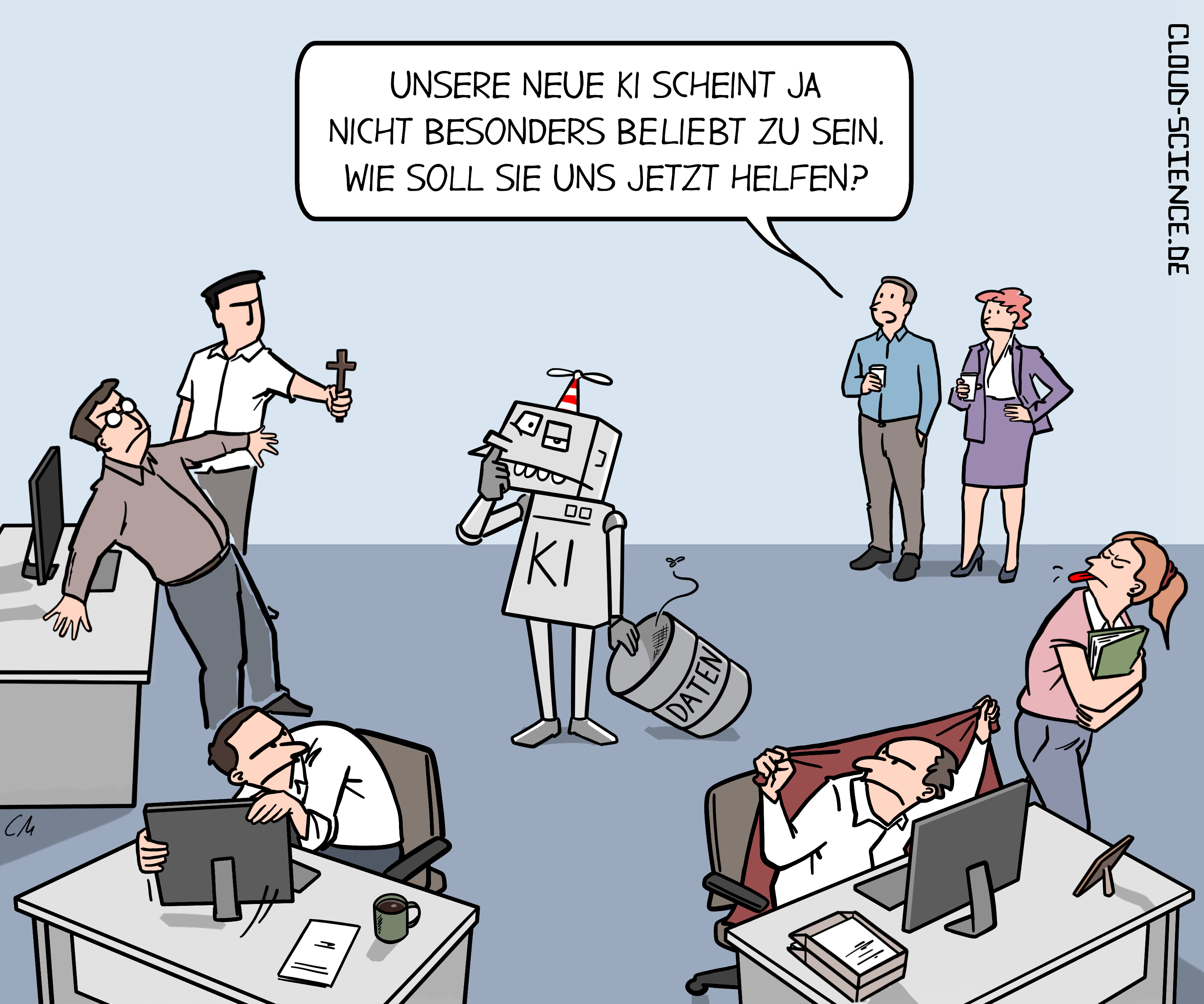

Die Einführung von Künstlicher Intelligenz scheitert in der Praxis oft nicht an der Technik, sondern auch an den Ängsten der Mitarbeiter.

TechToons

Schluss mit Grauzonen: Der EU AI Act tritt schrittweise in Kraft – ab 2. August 2026 gelten die vollen Regeln für High-Risk-KI-Systeme (z.B. am Arbeitsplatz). Unternehmen sollten jetzt mit Klassifizierung und Compliance starten, um Bußgelder zu vermeiden.

Wenn die Theorie zur Praxis wird: Der EU AI Act setzt ab August 2026 klare Grenzen für KI am Arbeitsplatz.

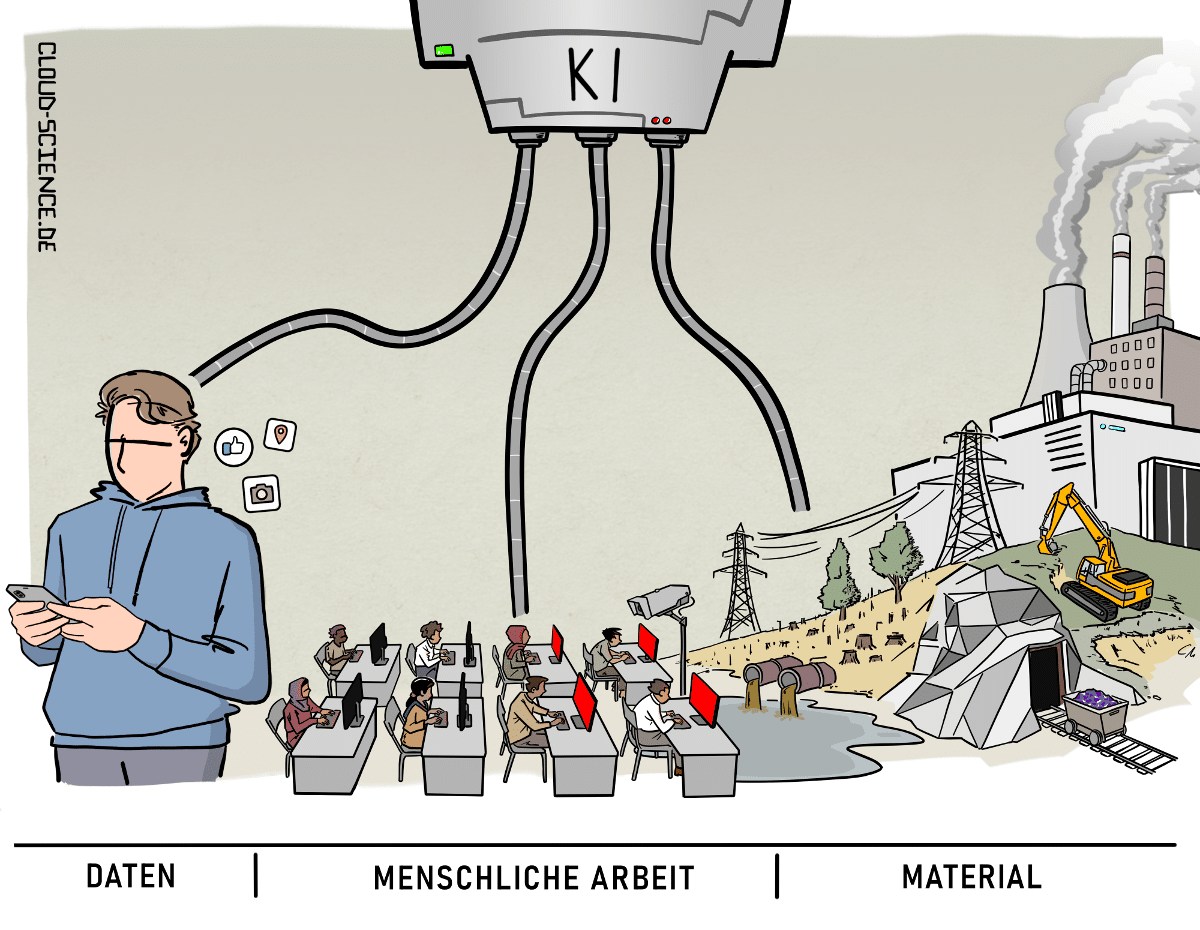

Künstliche Intelligenz entsteht nicht aus dem Nichts.

Sie fußt auf drei tragenden Säulen: der massenhaften Sammlung von Daten, der unsichtbaren Arbeit zahlloser Menschen – oft unter prekären Bedingungen – und der Ausbeutung enormer materieller Ressourcen.

Häufig wird sie mit magischen oder wundersamen Eigenschaften versehen, als handle es sich um eine körperlose Intelligenz. Hinter der glatten Oberfläche von „intelligenten“ Anwendungen verbirgt sich ein globales Netz aus Überwachung, menschlicher Klickarbeit, Energieverbrauch und Ressourcenabbau.

Vgl. Kate Crawford (2021): Atlas of AI. Yale University Press. Siehe auch Crawford & Joler (2018): Anatomy of an AI System.

Unternehmen stehen bei KI-Einführungen oft vor kulturellen Hürden:

Wenn Mitarbeitende Akzeptanzprobleme haben, horten sie Daten statt sie zu teilen. Das führt dazu, dass KI-Systeme kaum oder gar nichts lernen und ihre Wirkung verfehlen. Der wahre Engpass liegt also weniger in der Technik als in Vertrauen, Datenkultur und transparenter Zusammenarbeit – nur wenn Informationen frei fließen, kann KI ihre Kraft entfalten.